|

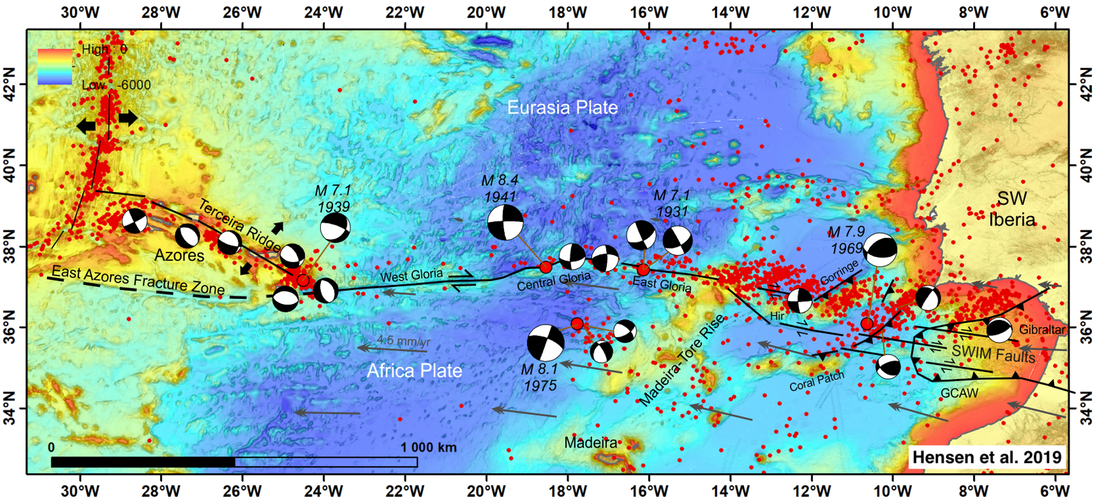

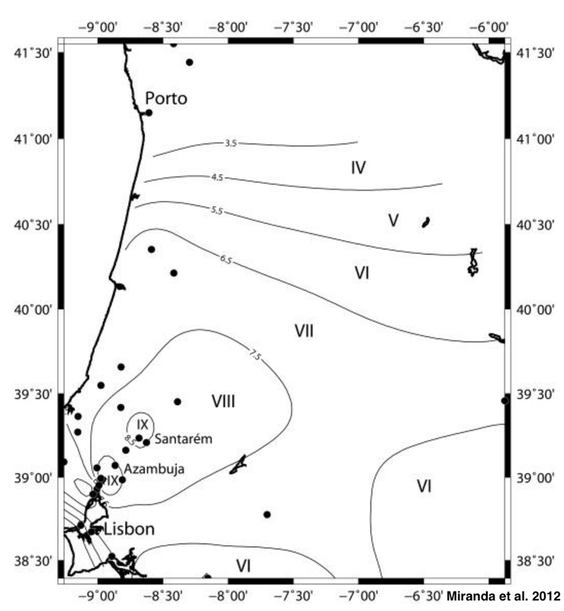

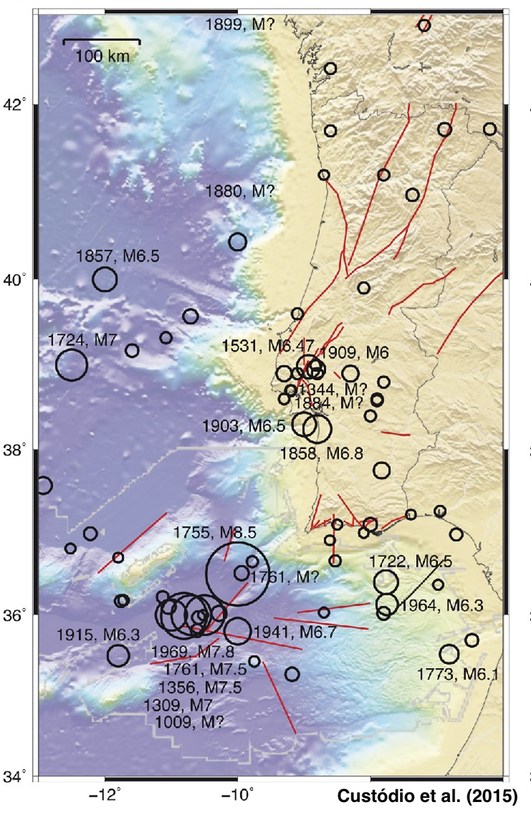

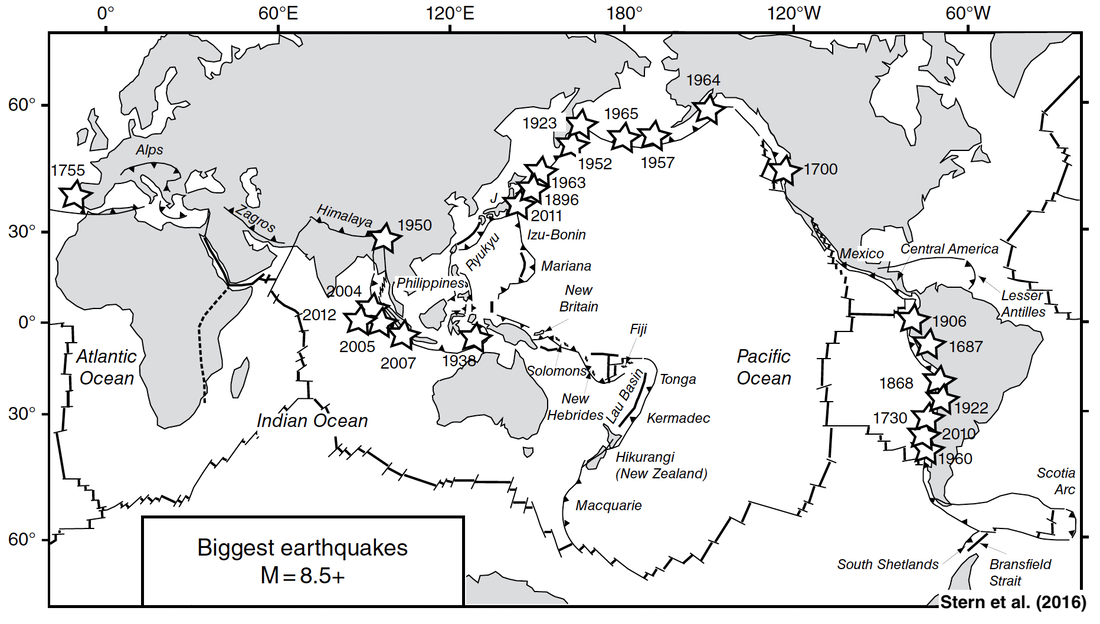

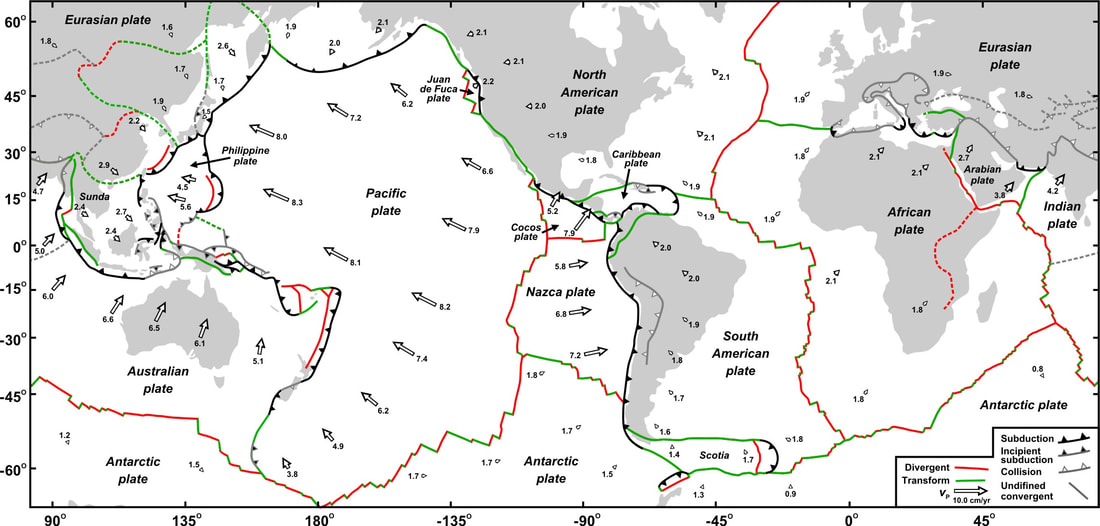

1 de novembro de 2023. Faz hoje 268 anos que se deu um dos sismos com maior impacto na História. O sismo de Lisboa de 1755 ocorreu no dia de Todos-os-Santos, por volta da 9:40 da manhã quando parte da população se encontrava a assistir à missa no interior de igrejas. Muito dos tetos ruíram. A mistura de velas e interiores de madeira deram origem a fogos que duraram dias. Aqueles que conseguiram escapar, fugiram para a parte aberta da cidade, junto ao rio. Quarenta minutos depois do primeiro tremor, uma onda gigante subiu o Tejo e inundou a parte baixa da cidade. O sismo terá tido uma magnitude superior a 8,5. As estimativas variam, mas terão morrido dezenas de milhares de pessoas. A destruição instantânea de uma capital europeia deu origem a uma onda de choque que alastrou pelo mundo ocidental. Os filósofos da altura, ao estudarem as causas dos sismos, abriram caminho para aquilo que hoje chamamos sismologia. Há até quem considere que foi aqui que teve início as ciências da Terra como disciplina científica. Terá sido 1755 um evento único? Qual a sua explicação? Se olharmos para o mapa (Hensen et al., 2019), vemos que só no século XX ocorreram, entre Portugal continental e os Açores, três sismos de magnitude perto ou superior a 8 (1941, 1969 e 1979). O primeiro teve mesmo uma magnitude de 8,4. No entanto, há quem considere que o maior perigo poderá não vir do mar, mas sim do interior do território continental, na zona do Vale do Tejo. Em 1531, ocorreu aqui um sismo de magnitude estimada de ~6.5, que terá tido uma intensidade máxima de X em Benavente (ver figura Miranda et al. 2012). Em 1909, um sismo de magnitude 6,0, na mesma zona, terá causado cerca de 70 vítimas. O chamado sismo de Benavente, atingiu uma intensidade de X, a mesma registada em Lisboa durante o sismo de 1755, mas num raio muito mais pequeno. Hoje, um sismo de magnitude 6,5 junto a Lisboa poderia ser catastrófico. Com estes exemplos, quero chamar a atenção para o facto de só nos últimos 100 anos terem ocorrido 3 sismos de magnitude perto de 8 ao largo da costa portuguesa, 2 sismos de magnitude 7,1 e um sismo em terra com magnitude 6. A ideia de que os sismos grandes só acontecem a cada 200 anos é um mito urbano. A dura realidade é que sismos de magnitude 6 a 8 ocorrem várias vezes por século e podem ocorrer a qualquer momento. O problema é que a nossa memória é curta. (ver imagem Custódio et al., 2015) E, porque há sismicidade? Portugal encontra-se numa zona de fronteira entre duas grandes placas tectónicas: a África e a Eurásia. Estas placas estão em rota convergente, o que leva à acumulação de tensão que é ciclicamente libertada sob a forma de grandes sismos. Estes causam a deformação da crusta, e é assim que as nossas montanhas vão sendo construídas, pouco a pouco. No entanto, ainda hoje se desconhecem as falhas que terão causado os sismos de 1755 e de 1969. Estas localizam-se a grandes profundidades no interior da litosfera. Por exemplo, o sismo de 1969 terá ocorrido a cerca de 30 km de profundidade. Nesta zona, a profundidade do mar é de cerca de 5 quilómetros, o que torna o seu estudo bastante complicado. Estudos recentes, mostraram também que a nossa margem poderá estar a ser reativada e a transformar-se numa margem ativa, o que explicaria a sismicidade de grande magnitude, da mesma ordem de grandeza da que se observa no famoso Anel de Fogo do Pacífico (ver imagem, Stern et al., 2016). Dada a perigosidade sísmica a que estamos expostos, e o seu desconhecimento, será preciso fazer muitos mais estudos, quer no mar, quer em terra (a falha do Vale do Tejo também é relativamente desconhecida). Alguma coisa tem sido feita, mas não chega. Neste momento o IPMA tem um sistema de alerta de tsunamis operacional e vão ser instalados sensores sísmicos na nova geração de cabos submarinos, que atravessam a fronteira de placas em dois sítios. Também há muito por fazer no que toca a construção sismo-resistente e à sua fiscalização. Não nos devemos alarmar, mas nunca é demais recordar que em 1755 ocorreu ao largo de Portugal um dos maiores sismos da história e que este não foi um evento único. #geologia Referências: Hensen et al., (2019): https://doi.org/10.3389/feart.2019.00039 Miranda et al. (2012): https://www.iitk.ac.in/nicee/wcee/article/WCEE2012_0685.pdf Custódio et al. (2015): https://doi.org/10.1093/gji/ggv285 Stern et al. (2016): https://agupubs.onlinelibrary.wiley.com/doi/10.1002/9781119054146.ch4

0 Comments

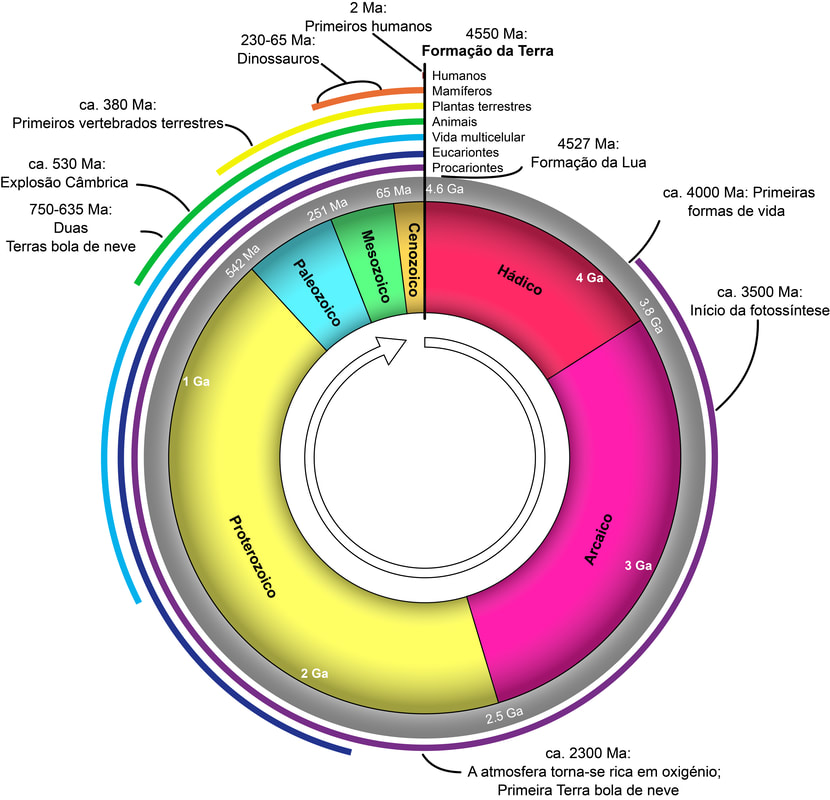

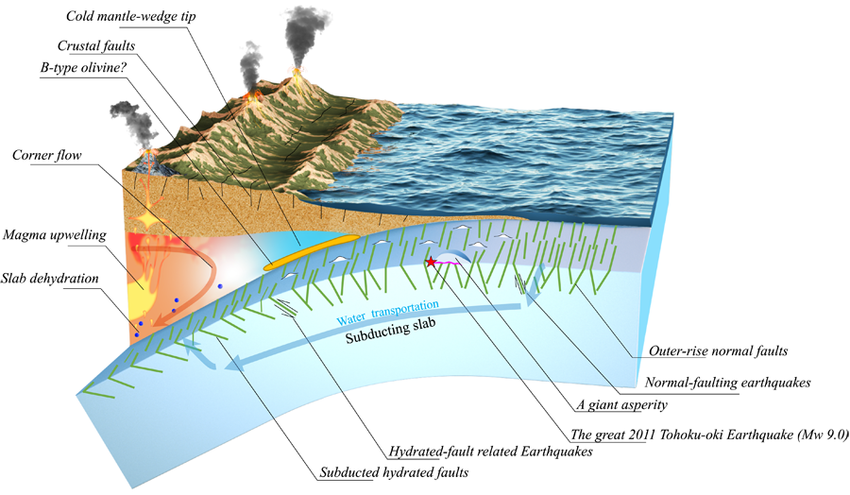

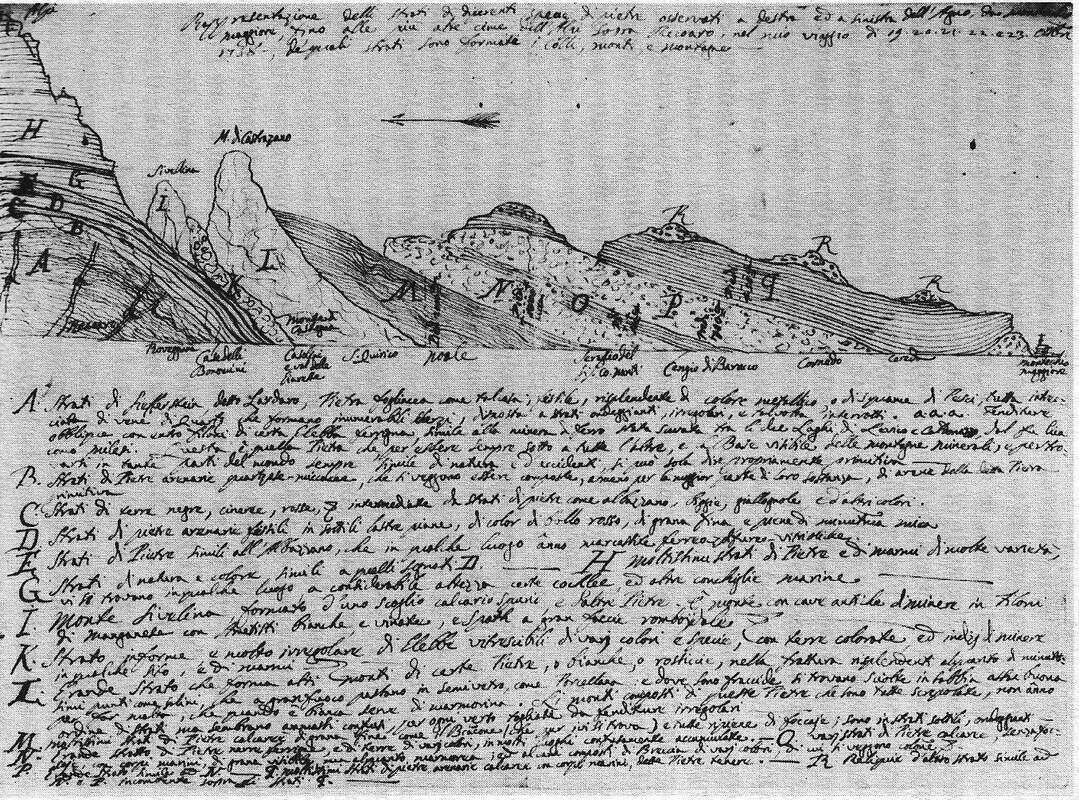

O Éon Hádico é uma divisão informal da história da Terra da qual não há um praticamente registo geológico. Apenas se encontram uns zircões, quase todos de uma formação em Jack Hills, na Austrália. O início do Hádico corresponde à formação da Terra há cerca de 4600 milhões de anos (Ma) e termina com o início do Éon Arcaico, há 4000 Ma. A palavra Hádico deriva do deus grego Hades, o rei do submundo. Pensa-se que Terra formou-se a partir da acreção de partículas de poeira e gás e do bombardeamento massivo de meteoritos. As suas colisões produziram energia cinética que, juntamente com o aquecimento radiogénico, levou à fusão parcial do planeta embrionário. Estes eventos levaram ao primeiro episódio de diferenciação da Terra e à formação de um núcleo metálico. Durante este período, é provável que a Terra ainda não tivesse uma litosfera estável ou uma crusta diferenciada. Pensa-se que os materiais iniciais que compunham a Terra continham uma quantidade significativa de água e, pouco depois da sua formação, formou-se uma atmosfera primitiva a partir da emissão vulcânica de voláteis, principalmente CO₂, hidrogénio e vapor de água. O vapor de água condensou-se num oceano, deixando para trás uma atmosfera principalmente composta por CO₂. A pressão atmosférica elevada permitiu que o oceano persistisse com temperaturas à superfície acima dos 100 °C. A análise de zircões sugere que já existia um oceano de água líquida há 4400 milhões de anos, e que o volume do oceano provavelmente não mudou significativamente desde então. Isso significa que, durante este período, a Terra deixou de estar coberta por um oceano de magma global e passou a ter uma crusta relativamente sólida. Acredita-se que a Lua tenha-se formado há cerca de 4500 milhões de anos, devido ao impacto de um proto-planeta do tamanho de Marte, chamado de Teia. Imediatamente após a sua formação, a Lua já se encontrava a cerca de 100 000 km da Terra, fora do limite de Roche, a órbita mínima abaixo da qual a Lua teria sido puxada em direção à Terra. A colisão entre Teia e a Terra fundiu parcialmente os dois corpos. A proximidade inicial entre a Terra e a Lua gerou forças de maré muito fortes que levaram a uma rápida recessão da Lua. Por volta dos 4100 Ma, a Lua já se encontrava a cerca de 275 000 km da Terra. Hoje encontra-se a 384 400 km. Pensa-se que no Hádico a superfície da Terra ainda não estava dividida em placas tectónicas e, portanto, não havia tectónica de placas. Também não há evidência direta de vida no Hádico. Porém, alguns trabalhos baseados em evidências indiretas sugerem que poderia já haver vida na Terra há 4280 milhões de anos. A origem da vida continua a ser um problema não resolvido. Na verdade, nem sequer existe um consenso acerca do que é a vida e o que a define (um dia, quando me sentir preparado, faço um post sobre o que é a vida e a sua origem). Fonte da imagem: Martin Sanchez via Unsplash #geologia A escala de tempo geológico corresponde à representação de uma linha de tempo baseada no registo geológico da Terra. O desenvolvimento da escala de tempo geológico foi um processo lento que começou muito antes de ser possível a datação absoluta. Por esta razão, grande parte da nomenclatura que utilizamos ainda é inconsistente, às vezes baseada no nome de localidades e regiões, outras vezes baseada no tipo de rochas ou nomeada após um evento. No entanto, nos últimos anos, os geólogos têm feito um esforço no sentido de desenvolver uma escala de tempo consistente. Essa tarefa está a cargo da Comissão Internacional de Estratigrafia. A escala de tempo geológico está organizada em Éons, Eras, Períodos e Épocas, muito semelhante a um calendário humano organizado em anos, meses, semanas e dias. As principais divisões correspondem geralmente a grandes mudanças nas formas de vida, muitas vezes extinções em massa, que na maioria parte dos casos se correlacionam com grandes processos globais, como mudanças climáticas, impactos meteoríticos, erupções vulcânicas, glaciações e formação ou rutura de supercontinentes. Existem quatro Éons: o Hádico, o Arcaico, o Proterozoico e o Fanerozoico. Nas próximas publicações, iremos viajar até cada um destes éons e explorar alguns dos eventos principais que neles ocorreram. Para isso, iremos referir a tabela mais recente produzida pela Comissão Internacional de Estratigrafia (ver comentários em baixo). #geologia #geology #tempo #time Imagem editada e adaptada da Wikipédia. Este ano editei um livro sobre a dinâmica da tectónica de placas e convecção do manto. O livro tem 24 capítulos e conta com a participação de alguns dos maiores especialistas em geodinâmica e tectónica de placas, num total de 40 autores. Quando iniciei o projeto, pedi aos autores que escrevessem artigos de perspetiva, apresentando o estado-da-arte e discutindo as fronteiras das suas subáreas de conhecimento. Desde então, várias pessoas têm-me perguntado onde podem comprar o livro na expectativa de aprender acerca das forças motrizes da tectónica de placas. No entanto, ficam surpresas quando lhes digo que não há nada explícito acerca das forças neste livro. E porquê? Quando convidei os autores e pedi-lhes para tentarem apresentar uma visão quantitativa da tectónica de placas, sugeri-lhes que discutissem as forças motrizes da tectónica de placas. A maior parte destes autores respondeu a dizer que isto já não era um tópico controverso. Será? Há cerca de 50 anos que sabemos que a principal força que faz mover as placas é o slab-pull. Isto não só foi proposto há 50 anos, como foi de facto demonstrado e testado através de observações. E desde então não houve nenhuma explicação alternativa, fundamentada em observações, que desmentisse esta hipótese. O artigo seminal que descreve (e testa) as forças motrizes da tectónica de placas foi publicado em 1975 por Donald Forsyth and Seiya Uyeda. E estes autores não foram sequer os primeiros a propor a ideia. Já Wolfgang Jacoby tinha feito os cálculos em 1970. O que Forsyth e Uyeda fizeram de novo foi testar esta idea através de observações. E o que eles concluíram foi, para uma determinada placa, há uma correlação clara entre o perímetro da placa que está a subductar, e a sua velocidade. Ou seja, as placas que sofrem mais slab-pull, estão a mover-se mais rápido. E isto vê-se muito bem! As placas não só estão a andar no sentido das zonas de subducção, como as placas que estão a subductar "mais" estão a mover-se mais rápido. Por exemplo, a placa do Pacífico, que está a subductar num parte significativa do seu perímetro, está a andar 6 a 8 vezes mais rápido do que a placa Euroasiática, que praticamente não está a subductar em lado nenhum. Mas este teste revelou algo ainda mais profundo. As correntes de convecção ascendentes têm pouco ou quase nenhum papel no movimento das placas. E aqui há duas nuances. A primeira é que as zonas de ascensão de material profundo não correspondem, em geral, às dorsais oceânicas, como tinha sido proposto por Harry Hess no início dos anos 60. A outra nuance é que uma das duas maiores zonas ascendentes está por baixo da placa africana, que está a mover-se a uma velocidade muito baixa. Se as correntes de convecção ascendentes fossem o motor da tectónica de placas, a placa africana deveria estar a andar muito mais rápido, e não está. Ou seja, a hipótese das correntes de convecção não está apenas desatualizada, contradiz as observações. Então porque é que as correntes de convecção continuam constar erradamente nos programas e nos manuais escolares como o motor da tectónica de placas? Imagino que possam haver várias explicações, mas penso que a principal é alguma confusão histórica e, eventualmente, alguma falta de compreensão física dos processos em causa. A convecção foi proposta por Arthur Holmes em 1929 como um mecanismo para explicar a Deriva Continental. No entanto, na Deriva Continental apenas os continentes se moviam. A superfície da Terra não era considerada como estando dividida em placas tectónicas, não havia fronteiras de placas e muito menos se imaginava que as placas estariam a afundar no manto. Ora, como consequência, a física dos processos da Deriva Continental é de facto muito diferente da física da Tectónica de Placas. Não se pode pegar nos elementos de uma teoria, e transportar para a outra.... Com a descoberta da tectónica de placas (no final dos anos 60 do século XX), quase imediatamente se percebeu que não eram as correntes de convecção ascendentes que faziam mover as placas (como mostra o artigo de Forsyth e Uyeda). E mais importante, pouco a pouco percebeu-se que é o próprio afundar das placas que gera a maior parte da convecção do manto. Ou seja, a convecção do manto é muito semelhantes à dos oceanos. É essencialmente impulsionadas pelo afundar do material frio e denso que arrefece à superfície. Não posso, no entanto, deixar de referir que ainda temos muitas dúvidas acerca dos detalhes da teoria dinâmica da tectónica de placas, mas hoje temos poucas dúvidas de que o slab pull contribui para cerca de 90% do movimento das placas. As restantes forças dividem-se entre o ridge-push, forças de sucção que se geram entre as placas, e o impacto local de plumas nalgumas zonas das placas. Esta hipótese é perfeitamente compatível com as observações e tem passado todos os testes desde que foi proposta há 50 anos. Mas se já sabemos isto há 50 anos, porque é que a ideia da convecção do Holmes, que tem mais de 100 anos e que foi proposta para explicar a Deriva Continental, continua a ser apresentada como o mecanismo por detrás da Tectónica de Placas? A explicação que consigo encontrar é que a Tectónica de Placas foi mesmo uma revolução e implicou uma profunda mudança de paradigma. Foi um pouco como a teoria de evolução de Darwin. Apesar de as “novas” teorias serem claras e fazerem todo o sentido, nós humanos estamos tão habituados a pensar de uma certa forma que nos custa (muito) mudar de paradigma. As revoluções científicas e mudanças de paradigma são o melhor que pode acontecer em ciência, mas têm um preço. Demoram e são difíceis de implementar, especialmente num mundo académico que tem alguma tendência para ser conservador. #geologia Forsyth and Ueyda, 1975: https://doi.org/10.1111/j.1365-246X.1975.tb00631.x Jacoby, 1970: https://doi.org/10.1029/JB075i029p05671 Fonte da Imagem: https://doi.org/10.1016/B978-0-323-90851-1.00003-0 (Texto especialmente direccionado a professores de geologia) Não se deve confundir fronteiras de placas divergentes, convergentes e transformantes com fronteiras de placas distensivas, compressivos e cisalhantes. A primeira está correcta, e a segunda pode não estar. Porquê? Vamos por partes. O conceito de placas rígidas é uma aproximação. Mas é uma boa aproximação. E, em geral, as placas são limitadas por zonas de fronteira relativamente bem definidas. As placas movem-se umas em relação às outras, podendo aproximar-se, afastar-se ou passar lateralmente uma pela outra. Reparem que até aqui estamos a falar apenas de movimento relativo, como deve ser. Se pensarmos a duas dimensões, quando olhamos para um mapa, faz sentido dizer que quando duas placas se aproximam uma da outra a aproximação causa compressão. Isto acontece porque num mundo a duas dimensões as placas não têm para onde ir. Mas há dois problemas. O primeiro é que o mundo não é bidimensional. Se considerarmos a terceira dimensão, uma placa pode mergulhar por baixo da outra sem que haja grande “colisão”. Uma analogia é quando deslocamos uma folha por baixo de outra. Estas podem deslocar-se sem que haja grande deformação, desde que uma passe por baixo da outra. É isto que acontece nas zonas de subducção. Uma placa mergulha sob a outra, sem que haja, necessariamente, colisão. O outro problema tem a ver com uma distorção histórica. Antes pensava-se que eram as correntes de convecção que causavam o movimento das placas, e que estas eram transportadas passivamente umas contra as outras. E quando estas colidiam, gerava-se compressão nos seus contactos. Mas hoje já não pensamos assim. Hoje sabemos que as forças que fazem mover as placas geram-se, de facto, junto às zonas de fronteira de placas. Um exemplo é o slab-pull. Ora, isto muda tudo. Se na natureza a placa que subducta fosse empurrada contra a placa cavalgante, isso poderia gerar compressão. Mas numa zona de subducção não é isso que acontece. O que acontece é que a placa que subducta (o slab) é puxado, ou sugado se quiserem, para o interior do manto devido ao seu próprio peso (imaginem puxar uma folha). Isto tem um efeito interessante e contra intuitivo. A placa que subducta sofre muitas vezes extensão junto à fossa, gerando-se falhas normais. A própria placa cavalgante muitas vezes sofre extensão, levando à geração de bacias de ante-arco e de retro-arco bordejadas por falhas normais. As falhas normais junto às fossas veem-se muito bem na batimetria e na sísmica de reflexão. Outro fator que contribuí para esta extensão junto à fossa tem a ver com o dobramento da própria placa que subducta. Se dobrarmos um pedaço de plasticina, esta vai gerar fendas extensionais. Acontece o mesmo quando dobramos uma placa. Concluindo. Apesar de nas zonas de subducção o movimento ser convergente, geram-se muitas vezes falhas normais, extensionais. Algo semelhante pode acontecer nas zonas divergentes. O ridge push empurra a placa a partir da dorsal, mas se placa for travada nalgum sítio, o ridge-push pode causar compressão no interior da placa. Reparem que push significa empurrar, e que pull significa puxar (e se puxarmos um pouco de plasticina esta vai sofrer extensão, e não compressão). Ou seja, o ridge push das zonas divergentes pode dar origem a estruturas compressivas (dobramento e falhas inversas) e o slab pull das zonas convergentes pode causar extensão (falhas normais). Eu sei que isto pode ser difícil de encaixar... mas é o preço que temos de pagar quando passamos a pensar na tectónica de placas em termos dinâmicos, e não apenas em termos geométricos e cinemática. Por isso, nunca confundam convergência com compressão. Fonte da imagem: Wang et al. (2022) #geologia Já todos tivemos um pouco de ouro nas nossas mãos. Alguns de nós usamos ouro todos os dias em anéis, colares ou pulseiras. O ouro é símbolo de vitória e de sucesso. Foi moeda de troca durante séculos, e causador de guerras também. Os alquimistas procuraram sintetizá-lo. Mal sabiam o que seria preciso! Há pequenas quantidades de ouro por todo o lado. Nos computadores, nos nossos telemóveis. O ouro é um elemento químico que geralmente se encontra no estado livre e não se liga nem interage com nenhum outro elemento. Isto, juntamente com o facto de ser relativamente maleável, faz do ouro um metal com valor económico muito procurado. Para além disso, o seu brilho amarelo característico e a sua raridade, fazem do ouro um metal precioso. Mas de onde vem o ouro? Da Terra, certo? E se eu vos dissesse que não há nenhum processo na Terra capaz de gerar ouro? Acreditavam? Bem, na verdade, praticamente nenhum dos elementos químicos que conhecemos foi gerado na Terra. Mas vamos por partes. Logo após a formação do espaço e do próprio tempo, no big bang, formaram-se três elementos: o hidrogénio, o hélio e um pouco de lítio. Para que a maior parte dos outros elementos fossem criados foi necessário esperar pela formação das estrelas. E para que estes elementos se dispersassem pelo Universo, foi preciso esperar pela sua morte. É no interior das estrelas e aquando da sua explosão que se formam a maior parte dos elementos que conhecemos da tabela periódica. Mas o ouro é um elemento pesado e nem uma estrela, ou mesmo uma supernova, são suficientes para o sintetizar. Estudos recentes mostraram que o ouro provém de um fenómeno especial: a colisão e fusão de duas estrelas de neutrões. Mas o que são estrelas de neutrões? As estrelas de neutrões são o que fica da explosão (supernova) de uma estrela com cerca de 20 vezes a massa do Sol. Estes objetos têm uma densidade impressionante, equivalente à de um núcleo atómico. Uma pequena porção de uma estrela de neutrões do tamanho de uma caixa de fósforos pesa cerca de 3 mil milhões de toneladas, mais ou menos o peso de uma pequena cadeia de montanhas. Hoje sabemos que cerca de metade das estrelas que observamos à noite são de facto sistemas binários, ou seja, sistemas constituídos por duas estrelas. Ora, quando algumas destas estrelas chegam ao fim das suas vidas, deixam para trás duas estrelas de neutrões. Em muitos casos, estas estrelas acabam por colidir e fundir-se. É durante este processo que se gera o ouro. Quando olharem outra vez para um pouco de ouro, pensem que este já esteve no meio de uma colisão entre duas estrelas de neutrões, algures no Universo, há milhares de milhões de anos e a milhares de milhões de quilómetros da Terra. O ouro é um pouco de estrelas de neutrões. #geologia Outras leituras: https://en.wikipedia.org/wiki/Neutron_star_merger https://www.nasa.gov/.../neutron-stars-create-gold.../ https://news.mit.edu/.../neutron-star-collisions-goldmine... https://www.science.org/.../neutron-star-mergers-may... Imagem: Greg Rakozy via Unsplash Adenda ao Post anterior intitulado “Quão grande é um sismo?” Os meus colegas sismólogos Luis Matias e Nuno Afonso Dias alertaram-me para alguns pontos que merecem um pouco mais de detalhe. Agradeço desde já aos dois pela atenção. O termo “sismo” é por vezes utilizado de duas formas distintas, o que pode causar alguma confusão. O interessante é que estas duas formas relacionam-se com os dois modos como medimos os “sismos”. Nunca tinha pensado nisto desta forma, por isso vou pensar aqui com vocês. Vamos a isso. Tecnicamente um sismo é o processo que ocorre quando o limite de resistência elástica da litosfera é ultrapassado e uma falha tectónica rompe, causando o movimento súbito de um bloco rochoso em relação ao outro. Durante este processo, parte das tensões tectónicas acumuladas são libertadas sob a forma de energia. Parte desta energia é utilizada para mover os blocos, outra parte perde-se sob a forma de calor (por vezes as rochas até fundem) e uma parte significativa é libertada sob a forma de ondas sísmicas. Ora, a magnitude é precisamente a grandeza que mede a energia sísmica que é libertada durante um sismo. É por isso que esta tem um valor preciso (com um erro associado) e não varia no espaço. A magnitude está relacionada com o processo na origem, na falha, a fonte do sismo. Uma outra forma de usar o termo sismo é quando dizemos “senti um sismo”. Aqui, no fundo, o que estamos a dizer é que sentimos a passagem de ondas sísmicas radiadas por um sismo. A intensidade sísmica (também designada de macrossísmica) é precisamente a medida qualitativa do grau de movimento do solo num determinado local. Se estivermos mais perto da falha, iremos sentir uma intensidade maior. Se estivermos mais longe, em geral, iremos sentir uma intensidade menor. No entanto, há aqui umas nuances muito importantes. A intensidade é altamente dependente da atenuação das ondas sísmicas e dos efeitos de sítio. A atenuação expressa a forma como a energia sísmica vai diminuindo à medida que nos afastamos da fonte, e esta é fortemente dependente do tipo de rochas que é atravessado pelas ondas sísmicas até estas chegarem ao local onde estamos. O resultado é que as isossistas nem sempre são regulares*. Há certas direções em que as ondas sísmicas se propagam com maior facilidade do que outras. Aqui vale a pena também referir a diretividade. Não querendo ir ao detalhe, basta dizer que geralmente as ondas sísmicas se propagam numa direção preferencial que se relaciona com o modo como a rotura da falha se propaga. Por um lado, temos os efeitos de sítio. Isto é, a forma como o substrato rochoso do local onde estou responde à passagem das ondas sísmicas. Certos materiais e construções podem amplificar as vibrações e influenciar a avaliação da intensidade macrossísmica. Por outro lado, a forma das bacias sedimentares atravessadas pelas ondas sísmicas pode causar fenómenos de ressonância (ou atenuação) que podem amplificar (ou atenuar) as ondas. Ou seja, a intensidade com que um sismo é sentido pode variar significativamente de local para local. É por isso que hoje em dia já quase não se desenham mapas de isossistas. Em alternativa, marcam-se, com a mesma cor, pontos de igual intensidade. Um outro efeito conhecido (e importante) associado à vibração sísmica, é a liquefação. Isto acontece quando os solos perdem a coesão e comportam-se como um fluido, podendo levar ao afundamento e colapso das construções. Dois últimos pontos importantes: 1. Nem sempre o hipocentro (local em profundidade na falha onde se gera o sismo, também denominado foco*) é o local onde o movimento da falha é maior. O hipocentro é simplesmente o local na falha onde o movimento se inicia. No caso recente dos sismos da Turquia, a situação foi ainda mais complexa. O hipocentro localizou-se num pequeno ramo menor e lateral da falha onde ocorreu o movimento principal. 2. As fontes dos sismos não são pontuais. Um sismo resulta do movimento de uma falha tectónica, e uma falha é um objeto bidimensional com uma extensão espacial. Por exemplo, em Sumatra 2004, o segmento da falha que rompeu teve um comprimento de quase 2000 quilómetros. É também importante notar que a rotura não é instantânea, mas inicia-se num local (o hipocentro) e propaga-se no espaço ao longo de um tempo (segundos, ou mesmo minutos). E à medida que a rotura se propaga, vão sendo geradas novas ondas sísmicas. Ou seja, as ondas sísmicas não são geradas apenas na região do hipocentro. Voltarei a estas questões relacionadas com os sismos mais à frente. Para já, fico por aqui. Aconselho também, vivamente, a consulta destes materiais da Sismologia na Escola: https://idl.ciencias.ulisboa.pt/sismologia-na-escola *Atenção que o conceito de isossista aparece por vezes mal definido. As isossistas são linhas imaginárias que separam regiões de igual intensidade macrossísmica. **O epicentro é o ponto (ou local) à superfície da Terra que está exatamente por cima do hipocentro. Crédito da imagem: Shefali Lincoln via Unsplash (https://unsplash.com/pt-br/fotografias/yNFVWsQicdg) Uma vez senti um sismo. Era de manhã. Não percebi o que era. Senti uma tontura e ouvi um ruído. Parecia um camião a passar, mas não havia estrada lá fora. Um dos meus sobrinhos saiu do quarto a gritar. Sismo! Tio, foi um sismo! Só aí me apercebi que tinha acabado de sentir a vibração de um sismo. Não foi muito grande. Vi depois no site do IPMA que tinha tido uma magnitude um pouco acima de 3, mas a sensação deve ter sido forte por estar mesmo em cima da sua fonte. Nesse momento pensei: como será sentir um sismo de magnitude 7, ou 8, ou mesmo 9 se estiver muito perto da sua fonte? Quão maiores serão em relação ao sismo que senti? Quão maior será um sismo de magnitude 7 em relação a um sismo de magnitude 3? Antes de lá irmos, precisamos de relembrar como medimos os sismos. Há duas formas. A primeira, é através da escala de intensidade. A intensidade é uma medida qualitativa da severidade do movimento do solo, que é avaliada através dos efeitos que o sismo tem sobre as pessoas, animais e construções. A escala de intensidade que hoje utilizamos é a Escala Macrossísmica Europeia (ver comentário). A intensidade tem, geralmente, valores mais elevado junto à falha que o gera, e diminui à medida que nos afastamos dela*. Ou seja, um sismo não tem uma intensidade definida. Esta varia em função da distância à falha que o gerou. Por exemplo, um sismo pode ter uma intensidade V junto à falha, uma intensidade IV a 100 km da falha, intensidade III a 200 km da falha, e por aí em diante. O sismo de 1755, por exemplo, teve uma intensidade IX em Lisboa, e V em Madrid (ver comentário). A segunda forma de medir um sismo é quantificar a energia mecânica libertada quando uma falha rompe. Isto é feito através do registo completo das ondas registadas pelos sismómetros. Os resultados são dados na Escala de Magnitude de Momento (ver comentário). A magnitude de momento é um número adimensional (com valores semelhantes aos da antiga Escala de Richter), mas o seu cálculo baseia-se no momento sísmico que é dado em joules (unidades usadas para medir a energia mecânica). Ok, parece que temos o que precisamos. Uma forma (objetiva) de quantificar um sismo. Vamos então a umas contas simples. Um sismo de magnitude 1 liberta cerca de 2000000 joules de energia. Um joule é equivalente à energia libertada quando deixamos cair uma lata de refrigerante no chão duma altura de 30 centímetros. Portanto, um sismo de magnitude 1 equivale a deixar cair 2 milhões de latas em simultâneo. Dois milhões de latas dariam para fazer um torre com 240 quilómetros (30 montes Everest). Ora, convém lembrar que a escala de magnitude é logarítmica. Cada vez que subimos uma unidade temos de multiplicar a energia libertada por 30. Assim, um sismo de magnitude 2 tem uma energia igual a 2000000 x 30, isto é, 63000000 joules. Ok, o valor triplicou e aumentou um zero. Não parece muito. O problema é que, como em qualquer escala logarítmica, os valores aumentam cada vez mais rápido. Vamos a isso. Então quão maior é um sismo de magnitude 7 em relação a um sismo de magnitude 1? O cálculo aproximado é o seguinte: 2000000 x 30 x 30 x 30 x 30 x 30 x 30 = 1450000000000000 joules E quão maior é um sismo de magnitude 9 em relação a um sismo de magnitude 1? É simples: 2000000 x 30 x 30 x 30 x 30 x 30 x 30 x 30 x 30 = 1312200000000000000 joules! O seja, um sismo de magnitude 9 liberta cerca de 1000000000000 mais energia que um sismo de magnitude 1. Só por curiosidade, esta energia é equivalente a deixar cair uma pilha de latas mais alta que o limite do sistema solar. E se compararmos o sismo que senti, de magnitude 3, com um sismo de magnitude 9? O resultado diz-nos que um sismo de magnitude 9 liberta cerca de 1000000000 mais energia que o sismo que senti! É bué! Difícil de imaginar... Se quiserem brincar um pouco com estes números, podem usar esta ferramenta: https://earthquake.usgs.gov/education/calculator.php Duas últimas notas. 1) A escala de momento de magnitude é uma escala aberta. O maior sismo alguma vez registado teve uma magnitude de 9,5. Ocorreu no Chile, em 1960. Mas poderão haver sismos maiores. Por exemplo, um impacto meteorítico pode gerar sismos com magnitude 10, ou mesmo superior. 2) Uma nota importante. A energia libertada por sismos pequenos, de magnitude 3, como os sismos que ocorrem quase todos os meses em Portugal, é insignificante quando comparada com a energia libertada pelos sismos muito grandes, como o de 1755. É por isso que não faz sentido dizer que os sismos pequenos são bons porque ajudam a libertar energia e evitam a ocorrência de um sismo grande. É como dizer que o copo de água fica significativamente mais vazio quando lhe tiro dois átomos de água. PS: Os cálculos são aproximados. Se apanharem algum gato avisem. *Esta regra nem sempre é cumprida, pois há regiões que devido a efeitos locais (como a liquefação dos solos) podem experenciar intensidades elevadas mesmo estando longe da falha. Por outro lado, se não houver pessoas nem construções (como num deserto) a medição da intensidade perde o sentido. Uma forma de medir os efeitos dos sismos com maior precisão é através de acelerómetros que medem diretamente o movimento e a aceleração do solo. Agradeço ao Nuno Afonso Dias e ao Luis Matias pelo feeback valioso que me deram e que serviu para melhorar consideravelmente o texto. Para mais informações, ver o site Sismologia na Escola: https://idl.ciencias.ulisboa.pt/sismologia-na-escola Fonte da Imagem: LoggaWiggler from Pixabay https://pixabay.com/photos/convento-do-carmo-former-monastery-211097/ No século XVII, Niels Steensen (1638-1696), também conhecido como Nicolas Steno, estabeleceu as bases do que se tornaria a estratigrafia. Steno, através da observação de camadas sedimentares, enunciou princípios simples que foram fundamentais para a organização do registo geológico. E do próprio tempo. O primeiro princípio é o Princípio da Horizontalidade Original, que afirma que todas as camadas sedimentares são depositadas horizontalmente. Este é um resultado direto da ação da gravidade. As partículas caiem na direção do centro da Terra e os estratos depositam-se ortogonalmente ao sentido da força da gravidade. Se uma camada não é horizontal, é porque um processo posterior atuou sobre ela (por exemplo, um evento que levou à sua deformação). O segundo princípio é o Princípio da Continuidade Lateral Original, que afirma que uma camada se estende em todas as direções até desvanecer nos limites da bacia. Se uma camada é abruptamente interrompida, é porque um evento/processo subsequente atuou sobre ela, como a formação de uma falha, por exemplo. O terceiro, e mais importante, é o Princípio da Sobreposição, que afirma que numa sequência sedimentar (uma sequência de vários estratos), a camada mais antiga está na base e as camadas suprajacentes tornam-se cada vez mais jovens até ao topo da sequência. Este princípio ficou conhecido como o Princípio Fundamental da Estratigrafia. Todos estes princípios parecem simples e óbvios, mas na época foram revolucionários. Notem, por exemplo, que se o dilúvio bíblico tivesse de facto ocorrido, era expectável que o registo geológico fosse muito mais desorganizado. Não seria de esperar que os estratos se encontrassem perfeitamente organizados em diversas sequências, apenas por vezes interrompidas por descontinuidades (ainda mal compreendidas). A realização de que as camadas sedimentares compreendiam sucessões temporais ordenadas de sedimentos teve grandes implicações. Permitiu ordenar o registo geológico e permitiu ordenar o tempo. Ainda não era uma medição exata, mas agora já era possível dizer que aquele evento aconteceu depois daquele outro evento. Nasce a cronoestratigrafia. Alguns anos mais tarde, com base em observações geológicas no norte de Itália (ver Figura em baixo), Giovanni Arduino (1714-1795) propôs a divisão da história da Terra em quatro períodos: Primitivo, Secundário, Terciário e Vulcânico, mais tarde designado por Quaternário. O Primitivo era composto pelas rochas duras que se encontravam no interior das montanhas, como os granitos, os xistos e os gnaisses. O Secundário deixou um registo de rochas calcárias estratificadas com fósseis marinhos. Por sua vez, as camadas que compreendiam o Terciário eram compostas por rochas menos consolidadas, por vezes com algumas conchas marinhas. E finalmente, o período Vulcânico correspondia às rochas formadas por vulcanismo atual, bem como a sedimentos fluviais e areias de praia. É interessante que alguma desta terminologia persista até hoje, em particular o Terciário e o Quaternário. Foi William Smith (1769-1839) que percebeu que diferentes camadas tinham diferentes conjuntos de fósseis e que isso era verdade mesmo quando o tipo de rocha era diferente. Ele não sabia por que isto acontecia — Darwin ainda tinha que descobrir a evolução — mas foi a chave para correlacionar diferentes camadas por todo o mundo. Isto ficou conhecido como o Princípio da Sucessão Fossilífera e foi a base para o que ficou conhecido como bioestratigrafia. O que permitiu o desenvolvimento da geocronologia relativa. A última chave do puzzle foi introduzida por Charles Lyell (1797-1875), como o Princípio das Relações de Corte, que afirma que se uma formação rochosa está falhada ou é intruida por uma outra rocha, a atividade da falha e a rocha intrusiva são posteriores à formação rochosa original. Este conceito teve uma grande importância para a organização do registo geológico em regiões complexas e deformadas, onde o registo fóssil muitas vezes não existia. Uma extensão deste princípio é o Princípio da Inclusão. Se uma rocha sedimentar contém outra rocha, a rocha que é contida é mais antiga do que a rocha que a contém. Alguns anos mais tarde, inspirado no livro de Lyell Princípios de Geologia, Charles Darwin (1809-1882) desenvolveu uma teoria que permitiu explicar porque é que rochas de diferentes idades têm diferentes conjuntos de fósseis — a teoria da evolução. No entanto, a geocronologia absoluta só foi possível após a descoberta da radioatividade por Henri Becquerel (1852-1908) e Maria Salomea Skłodowska-Curie (1867-1934). Isto é, a datação precisa de uma determinada rocha que continha, ou não, um determinado registo fóssil. A geocronologia absoluta, introduzida por Bertram Boltwood (1870-1927), baseia-se no facto de que alguns isótopos radioativos (ditos pai) se transformarem noutros ao longo de milhões de anos (ditos filho). O tempo que metade dos isótopos pai levam a transformar-se nos isótopos filho (período de semi-vida) é determinado, conhecido e constante para cada elemento. Assim, sabendo a quantidade inicial do isótopo pai e a quantidade dos elementos filhos no dia de hoje, os geólogos conseguem calcular com grande precisão a idade da rocha. Finalmente, tínhamos ao nosso dispor uma ferramenta poderosa para quantificar o tempo geológico. A partir deste momento, podíamos datar uma determinada rocha de forma exata. Por exemplo, uma rocha vulcânica que sabíamos ter a mesma idade de uma outra rocha que continha um determinado fóssil de idade (fóssil de um organismo que viveu num período específico). Podíamos saber que essas duas rochas tinham a mesma idade aplicando os princípios enunciados em cima. A partir daí, e já com uma datação absoluta em mãos, é então possível extrapolar a idade de qualquer outra rocha, em qualquer outro ponto do mundo, que contenha esse fóssil. É isso que fazemos ainda hoje. As datações absolutas ainda são caras e dispendiosas. Partes do texto adaptadas de: Duarte, J.C., 2023. A timeline of Earth's history. In Green., M., Duarte, J.C., eds, A Journey Through Tides, 117-131. Elsevier Books. https://doi.org/10.1016/B978-0-323-90851-1.00010-8 Outras leituras que inspiraram partes deste texto: Galopim de Carvalho, A.M., 2014. Evolução do pensamento geológico: nos contextos filosófico, religioso, social e político da Europa, 1ª ed. – Lisboa, Âncora, 277 p., ISBN 978-972-780-436-8 Levin, H.L., and King Jr., D.T., 2016. The Earth Through Time, 11th ed. Wiley, 2016, ISBN: 978-1-119-228. Crédito da imagem: Peter Forster, via https://unsplash.com/pt-br #geologia Neste momento estou sentado no meu quarto a escrever ao computador. Está calor, a janela está aberta e tenho uma ventoinha ligada. Todos os meus sentidos dizem-me que estou parado. Mas será que estou?

Não, não estou. Ora vejamos. A Terra desloca-se a 100 000 km/hora pelo espaço. Ui! Isto parece muito. E é! Mas não é tudo. O sistema solar está a mover-se como um todo a 70 000 km/hora em relação às estrelas mais próximas. Mas não acaba aqui. O nosso grupo de estrelas está a mover-se a cerca de 830 000 km/hora em relação ao centro da galáxia. E a nossa galáxia está a mover-se a cerca de 2 000 000 km/hora através do universo. Se somarmos tudo, significa que podemos estar a mover-nos a 3 000 000 km/hora. O que é equivalente a mover-nos a cerca 800 quilómetros por segundo! Afinal não estou parado. Estou numa viagem. Estamos todos. Porque é que não sentimos nada? A física explica. Estamos em movimento uniforme. Não é retilíneo, mas é quase. Como tal, não estamos sujeitos a nenhuma aceleração e não sentimos nenhum força relacionada com este movimento. É um pouco como quando estamos num avião em velocidade de cruzeiro (sem turbulência). No entanto, sentiríamos esta força se a Terra (ou a galáxia) parasse de repente. Esperemos que não... Uma consequência interessante deste raciocínio é que a Terra completa uma volta à galáxia a cada 230 milhões anos. O que quer dizer que os dinossauros quando andavam por cá, há 115 milhões de anos, estavam de facto do outro lado da galáxia. A cerca de 50 000 anos-luz de nós. __________ Crédito da imagem: Trevor Mckinnon via Unsplash |

RSS Feed

RSS Feed